Хостинг firstvds.

Вау, у вас сервер?

ау у меня максимум 15 секунд, контент загрузился через 4 секунды

Да, 6 ядер. Но сайт всё равно тормозит вплоть до неоткрытия через 2-3 дня после перезагрузки.

сервер настраивал кто?

Простите, но есть ощущение типа «рукиоторвать»

Правда, у нас сервер немного мощнее (8 ядер, 8 Гигов оперативки) и, наверное, контента на главной поменьше. Но есть ощущение (инструмент https://ping-admin.ru/free_test/ ) что грузится наш заметно побыстрее.

Ваш: https://ping-admin.com/free_test/result/166015389306ays7e8e10in6m53z21c.html

Наш: https://ping-admin.com/free_test/result/1660154087eqe510546416gf4g88brpz.html

Сервер настраивал наш спец. Не перегружаем месяцами.

Чтобы просто убрать все ссылки с параметрами

Disallow: *?

И в User-Agent: Yandex, и в User-agent: Googlebot, и в User-agent: *

Директива Clean-param - это для очень умных с черным поясом по программированию. Будет трафик 100K в день - можно заморочиться.

А у вас какой оператор?

В видео красной линией проходит исключение из индексации страниц пагинации. Это окончательно верное решение от SEO сообщества или все таки лучше будет их оставить в индексе но с тегом canonical на первую страницу категории?

И еще очень актуальный для меня вопрос закрывать ли вариации товаров от индексации по параметру ?variation_id=ххх

Сейчас вариации открыты к индексации и они постоянно то попадают в индекс, то исключаются как “неканонические”

Ответ одного из кураторов:

"есть разные подходы, каждый из которых имеет плюсы и минусы.

чтобы пагинация не лезла в индекс и не спорила релевантностью с основной страницей, при условии, что у вас все хорошо со структурой и перелинковкой, ее можно закрыть. noindex, follow

можно проставить на пагинацию каноникал. но это не гарантия того, что пагинация не будет попадать в индекс. если товарная выкладка будет сильно отличаться от первого экрана, она все равно зайдет в поиск.

В чате показывали примеры открытой пагинации и оптимизации ее под гео-траф и под нч запросы. Также есть кейс Алекса, как он со страниц пагинации получал гео=траф.

Еще один вариант - открыть пагинацию к индексу и разоптимизировать ее, убрать плитки тегов, текст, часть тайтла и добавить в мета-теги номер страниц.при плоской структуре проблем с индексацией быть не должно. со вложенной структурой - вполне вероятно, если кроме как на пагинации, ссылки на товары у вас больше нигде нет."

Моё мнение - закрывать, если не поняли ничего из написанного выше.

Если поняли - мои советы Вам не нужны ![]()

noindex, follow и жесткое закрытие в robots.txt мне кажется разные вещи. Или нет? В случае с закрытием в robots страницы пагинации совсем не будут обходиться.

![]()

У меня вопрос.

Допустим, в категорию товары добавляются чаще, чем её обходит бот поисковика, и раз в несколько дней первая страница категории полностью обновляется и вся занята уже новыми товарами.

Как бот узнает о существовании других товаров, которые добавлены между его заходами на сайт? А он по-любому заходит не каждый день.

Для этого существует настройка в вебмастере Яндекс - использовать метрику для индексации магазина.

- Регулярно обновлять sitemap.xml

Модуль называется Карта сайта для Yandex и Google (почему не sitemap.xml?)

Информация

Если были добавлены или изменены товары, категории и т.д., пожалуйста обновите файл Sitemap: Обновить

-

Как правильно сказал MAURISWEB.RU в Вебмастере включите Индексирование - Обход по счетчикам - Управление обходом страниц с помощью счётчиков Яндекс Метрики

-

Очень полезно добавить в Вебмастер - Товары и предложения - Источники данных товарный фид YML. Его генерирует модуль Яндекс Маркет - “Генерация выгрузки в Яндекс.Маркет”. Фид надо потом регулярно обновлять, тоже руками, сам он не обновляется.

Из этого фида ,если/когда он пройдет модерацию (от 5 рабочих дней) и проверку (тестовый заказ) формируется красивый товарный колдунщик в выдаче Яндекса по товарным запросам.

-

Перелинковка на страницах карточки товаров - блоки “С этим товаром покупают”, “Рекомендуемые товары”, “В эту же цену”, “Новинки”, “Хиты продаж”, “Распродажа”, “Уцененные товары” и прочее.

Все эти нехитрые манипуляции позволяют заставлять ботов поисковых систем пробегаться по всем страницам и индексировать всё.

Для контроля надо иногда скачивать Все страницы сайта, известные Вебмастеру и проверять, чотамчотам ![]()

У меня привязан счётчик метрики в Вебмастере.

Да, про карту сайта я не подумал

В сатмапе у всех страниц проставляется одна дата. Один платный сервис выдает это как ошибка. Насколько это критично если у всех одна и та же дата, я так понимаю, это руководство боту обходить весь сайт даже те страницы которые как бы обходить не стоит т к их не обновляли.

И такой вопрос. Чем завлечь гошу. Домену 2 месяца (до этого висели чьи то сайты (не блокированные) яша и гоша находит ошметки). Все что рекомендованное есть … яша уплетает за обе щёки. Гоша ни в какую. Если насильно по одной странице скармливаешь, нехотя индексирует но при этом говорит, что в сайтмапе страницы нет хотя она есть. Есть ли какой то способ кроме API?

имхо не стоит жестко запрещать Нужно на страницах пагинации от page-2 до page-n прописать строку

в свое время варианты, сортировки и т д закрывали т к пух кэш … насколько я понимаю такой проблемы нет. но опять имхо, разбазаривать ресурсы робота на сканирование незначащих страниц наверное не стоит. у меня по несколько дней висят странице в статусе Данные о каноническом адресе обрабатываются

Google теперь просто так не индексирует. https://add-my-url.com/ либо Telegram: Contact @Link_Indexing_bot либо Google Indexing API: как установить, пошаговая инструкция, быстро проиндексировать сайт либо арендная ссылка на sape на неделю на доноре с быстророботом.

Google Indexing API из них самый правильный путь.

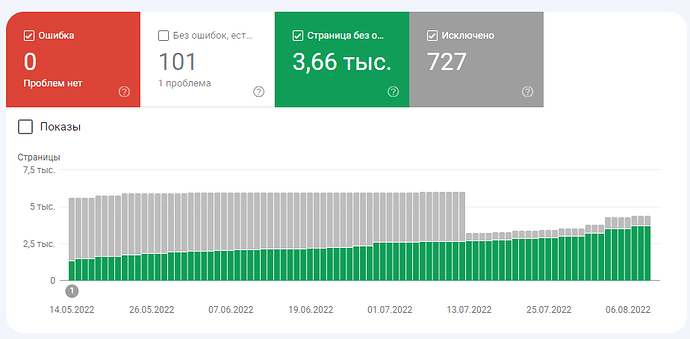

У меня индексация нового сайта выглядит примерно так, около 1000 страниц в месяц